Как заставить браузер читать вслух любую статью

Современный человек перегружен информацией и делами, и иногда у нас нет времени, чтобы прочитать какую-нибудь интересную статью, особенно если она длинная. Приходится откладывать чтение на потом, но далеко не факт, что вы вспомните о ней.

Удобный вариант — добавить в браузер расширение, которое озвучит текст статьи голосом в то время, когда вы занимаетесь каким-нибудь делом. Само собой, нужно расширение с поддержкой русского языка.

Как добавить синтезатор речи в браузер?

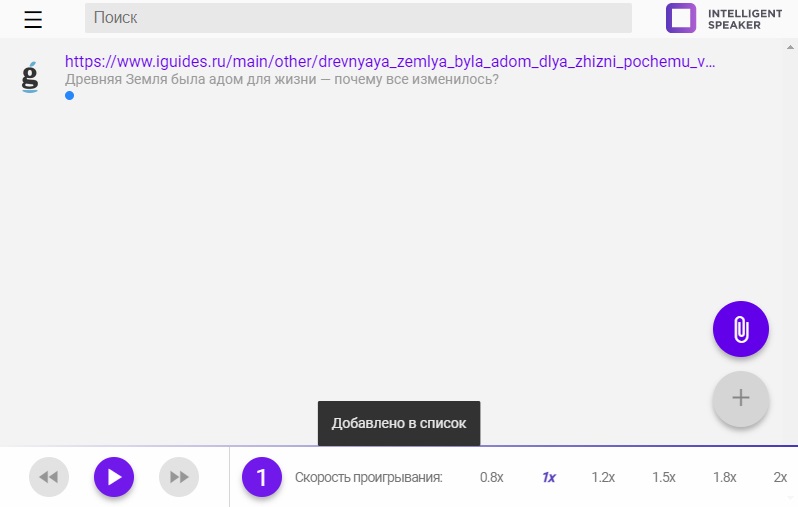

Если вы используете Chrome, Firefox или Opera, установите расширение Intelligent Speaker. Оно поддерживает два десятка языков, включая русский, и автоматически озвучивает текст на веб-странице.

В очередь можно добавить несколько ссылок, тогда расширение будет последовательно читать вам текст с каждой из этих страниц. Также можно загрузить в него текстовый файл в формате.pdf, .txt или.docx — текст будет распознан и озвучен. Озвученный текст можно скачать в формате.ogg, который воспринимается большинством плееров.

В расширении есть перемотка для быстрого перехода к разным фрагментам текста, кнопка паузы для приостановки чтения и настройки скорости чтения от 0,8x до 2x. Не хватает только выбора голоса, есть только женский, и робот иногда коверкает слова или неправильно ставит ударения, чем усложняет восприятие текста. Недостаток этого расширения в том, что в месяц можно бесплатно слушать всего один час озвучки текста, а затем надо оформлять платную подписку.

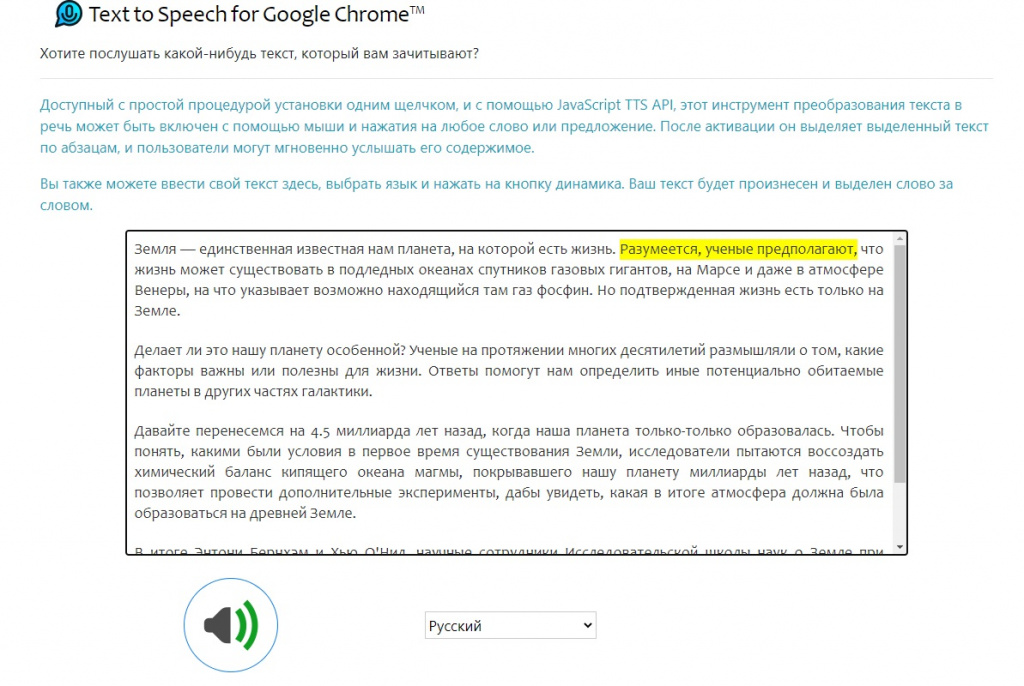

Расширение Text To Speech менее удобное, зато бесплатное. Текст, который вам нужно озвучить, приходится копировать и вставлять в специальное поле, а голос слишком роботизированный, с металлическим призвуком. На сайте texttospeech.freebusinessapps.net можно скачать mp3-файлы с озвученными текстами.

Первые поисковые роботы и индексация

Прежде чем понять, что такое роботы пауки поисковых систем и как это работает, нужно разобраться в том, что такое современная поисковая система. Свою популярность интернет начал набирать в 90е на территории стран СНГ.

Поисковая система того времени искала точные слова или словосочетания в тексте. Это доставляло массу неудобств, так как русский язык имеет занятную особенность. Одно и то же понятие можно сформулировать в 10-20 вариантах и получится одно и то же.

Все люди разные и мышление у каждого свое. Разработчик сайта не мог на то время прописывать по 20-30 точных фраз на странице, которые возможно моги бы использоваться для поиска данного материала.

Соответственно пользователь часто не мог найти интересующий его материал только потому, что его формулировка проблемы не совпадала с формулировкой в тексте.

Следует отметить, что тогда не было такой жесткой конкуренции и сайт продвигались совсем иначе. Раскруткой сайтов занималось очень мало людей, тогда эта область еще не была поставлена на конвейер, которым он является сейчас.

Это было просто не нужно, очень мало людей имело домашний компьютер и еще меньшее число позаботилось о подключении интернета. Любой магазин в сети был больше похож на объявление, приклеенное на столб, чем на то, что мы видим сейчас в интернете.

Все это очень тормозило развитие поисковых систем и всей кибер индустрии. К слову сказать, тогда уже были роботы поисковых машин и индексация. Вы уже понимаете, что выводилось в результатах поискового запроса.

Теперь следует объяснить, как именно были устроены первые самые простейшие поисковые роботы.

Для того чтобы просканировать текст нужно время. Сейчас это кажется смешным, текст стал настолько легким и незначительным в глазах современных компьютеров, что сложно представить себе машину, которая бы работала над ним несколько минут.

Однако так и работали компьютеры той эпохи. Значит, сканировать все тексты и материалы по запросу невыгодно по времени. В индекс заносились только заглавные названия и названия страниц.

Вот и объяснение, почему нельзя было разместить 20-30 вариантов с формулировками запроса. Так вот, задачей поискового робота являлась сканирование по запросу заглавных названий и названий страниц.

Сейчас поисковые роботы и индексация запущены в постоянную работу на мощнейших серверах, тогда же все работало по принципу «каждый сам за себя». Любой поиск совершался силами персонального компьютера, на котором был сделан запрос.

Пожалуй, в заключение рассказа о первых поисковых роботах можно добавить только то, что сайт глазами поискового робота выглядел как 2 строчки печатного текста.

Тогда поиск был не таким распространенным, сайты искали на досках объявлений, каталогах сайтов и по рекламе, а так же по рекомендации друзей и знакомых.

Каталоги сайтов – это один из тех реликтов, которые существую и сейчас, они заслуживают более подробного писания, позднее вы поймете, почему они больше не актуальны. Поисковые запросы того времени выглядели следующим образом:

Поисковой робот google

Приблизительно в 2003 году начал активно набирать обороты проект Google. То, на что сегодня молятся практически все люди, работающие в сфере SEO. Можно сказать, что если бы не Google, то не было бы никакого SEO, но об этом позднее.

Итак, в 2003 году уже существовали поисковые системы, которые гораздо более тщательно обрабатывали информацию и предлагали пользователю качественный поиск не только по названия страниц и заголовкам, а по самому тексту.

Тогда алгоритмы поиска работали, настолько криво, что никому и в голову не приходило пытаться их обмануть. На тот момент персональный компьютер уже не был роскошью, однако до современной популярности интернета было еще очень далеко.

Объем интернет аудитории рос с каждым днем, и многие предприимчивые люди сделали ставку на интернет бизнес.

Поиск текста в то время все еще работал по принципу точного вхождения, тогда незаметная компания Google начала свое восхождение на Олимп.

Этот сервис предлагал пользователю поиск информации по фразе, однако при поиске не учитывался падеж, в котором стояли слова. Код поискового робота Google для сайтов анализировал слова по значению и не учитывал падежи.

Такой тип поиска сразу же принес популярность этой поисковой системе. Чуть позже разработчики переделали алгоритм работы поискового робота так, что он начал использовать синонимизацию, стараясь найти наиболее подходящие тексты для пользователя.

На этом этапе развития, компания Google, уже была мировым лидером в сфере поиска. Случилось это из-за того, что в итоге пользователь, использовав любую формулировку, получал нужную ему информацию.

В то время началось изменение стандартной формулировки поисковых фраз.

Они начинали приобретать сегодняшний вид:

Можно наглядно проследить изменения в формулировке. Учитывая, что такие формулировки не очень характерны для описаний, поисковый робот Google, прекрасно справлялся с поставленной задачей.

В то время разгорался костер поисковой оптимизации, люди начали зарабатывать на сайтах. Конечно, всегда были специалисты, которые занимались продвижением интернет ресурсов, однако тогда начиналось более-менее массовое движение.

Люли стали интересоваться, как именно происходит ранжирование в поисковой выдаче, приходил ли поисковый робот на их сайт и это породило целый пласт науки о SEO. Эта область занималась изучением того, как роботы поисковых систем выполняют индексацию.

Роботы поисковых систем | мастер-классы seonews

1.

2.

3.

4.

5.

6.

1. Вступление. Что такое робот?

Роботы поисковых систем – это неутомимые труженики Интернета, постоянно просматривающие сотни тысяч сайтов и гигабайты текста в поисках самой свежей и интересной информации.

Что же собой представляет робот? Если сказать просто, это небольшая программа, просматривающая страницы сайта и собирающая некоторую информацию, которую впоследствии передает в базу поисковой системы. Задачи роботов довольно разнообразны, но в общем случае – это индексация содержимого интернет-страничек.

2. Робот как часть поисковой системы

В общем случае поисковая система выполняет две задачи: индексирование и поиск. Процесс индексирования заключается в получении и переработке страниц интернет-сайтов и последующем ее хранении. При этом индекс (базу) поисковой системы стараются устроить таким образом, чтобы процесс поиска был как можно более быстрым и эффективным.

Например, индекс поисковой системы Яндекс основывается на инвертированных файлах, т.е. текст любого документа хранится в виде упорядоченного списка всех встречающихся в документе слов с указанием позиции слова. При этом адрес позиции делают обычно относительным. Далее файл сжимается, но не очень сильно, чтобы не требовалось в последующем много затрат процессорного времени на распаковку файла.

За индексирование в поисковой системе отвечает робот, основным компонентом которого является модуль скачивания. Модуль скачивания обращается по протоколу HTTP к серверам, на которых хранятся странички, и получает в ответ тело странички, при этом ему все равно, каким образом она страница была сформирована сервером, статическая она или динамическая, имеет ли расширение .htm или .php.

Модуль скачивания подчиняется указаниям, прописанным в файле robots.txt , который лежит в корневой папке сервера. В robots.txt указывается, какие страницы запрещены к индексации роботом.

Для уменьшения трафика модуль скачивания не загружает страницы, которые присутствуют в спам-листе робота. Обычно, это сайты, наказанные за нарушение правил поисковых систем, за попытку влияния на алгоритмы ранжирования.

Кроме модуля скачивания, осуществляющего предварительную фильтрацию, в роботе присутствует модуль отслеживания дубликатов, который отбрасывает повторяющиеся документы.

Также в роботе есть модуль, который определяет кодировку сайта и язык. Например, Яндекс обычно индексирует только русскоязычные сайты.

После обработки документа всеми вышеперечисленными модулями робота, документ анализируется html-парсером, который оставляет только самое нужное и весомое для поиска: текст, оформление, ссылки и адреса. Все это при поиске будет влиять на ранжирование странички.

После обработки парсером происходит индексирование документа. При этом используются алгоритмы морфологического анализа. В конце концов, документ инвертируется и добавляется к основному индексу.

3. Порядок индексирования страницы роботом

Робот поисковой системы индексирует новые сайты, находя их по ссылкам с других страниц Интернета. Однако самый быстрый путь к индексации сайта поисковой системой – это самостоятельно сообщить ей, что в Интернете появился новый ресурс.

Для Google это страница , для Рамблера – . Для Яндекса это можно сделать на странице .

После ввода адреса сайта, специальный робот проверит, возможна ли индексация сайта, нет ли технических препятствий к этому.

Через некоторое время (обычно через один-два дня) страницу посетит основной индексирующий робот, который и соберет информацию для поисковой системы.

Сначала робот запрашивает на сайте файл robots.txt, на основании данных которого будет происходить дальнейшая навигация. Если страница не запрещена к индексации (о том, как управлять индексацией – чуть позже), то она посещается роботом.

При обращении к странице робот формирует http-заголовок, идентифицируя себя как User-Agent: Yandex/1.01.001 (compatible; Win16; I) (или по-другому, в зависимости от типа робота), иногда указывает свой ip-адрес.

Как и обычный браузер, робот может запросить дату последнего изменения страницы с помощью заголовка «if-modified-since» и на основе отдаваемого сервером «last-modified» сделать вывод о том, изменилась ли страница с момента последнего захода. Если нет – то повторная индексация не требуется. Однако сегодня большинство страниц – динамические и формируются сервером «на лету». Такие страницы имеют значение «last-modified» равное дате обращения к этой странице. Получается, что за несколько недель текст страницы может не измениться, а по значению «last-modified» получается, что страница обновлена. По этой причине многие роботы сегодня игнорируют отдаваемый сервером заголовок «last-modified» и определяют сами – изменилась страница или нет.

При обращении к конкретной странице робот определяет кодировку документа, анализируя мета-тег < meta http-equiv=”Content-Type” content=”text/html; charset=windows-1251″> или при его отсутствии – определяет самостоятельно.

Для htm-документов робот анализирует не только текстовое содержание, но и теги html, на основе которых в дальнейшем будет оцениваться релевантность страницы. Но если теги html робот «понимает», то java-скрипты – нет. Поэтому не рекомендуется использовать скрипты в значимых элементах сайта: например, красивое выпадающее меню, написанное на java-script, может негативно сказаться на индексации страниц, на которые ведут ссылки из меню, так как такие ссылки робот может и пропустить.

Также не рекомендуется использовать различные «события», указываемые как параметры тега при простановке ссылок.

Существует еще один тег, который специально запрещает индексирование текста, расположенного в нем – . Однако, данный тег воспринимается только роботом поисковой системы Яндекс.

4. Типы роботов

Каждая поисковая система имеет своего робота, который при посещении страниц представляется определенным образом. Для того чтобы узнать на какую страницу вашего сайта какой зашел робот, нужно проанализировать логи сайта, которые автоматически пишутся сервером apache. Например, что нам может сказать вот такая строчка в log-файле:

213.180.216.4 – – [05/Jun/2006:21:26:52 0400] “GET /contacts.htm HTTP/1.1” 200 6762 “-” “Yandex/1.01.001 (compatible; Win16; I)”

Эта запись означает, что с ip-адреса 213.180.216.4 пятого июня 2006 года в 21:26:52 на страницу «контакты» заходил робот Яндекса, обратившись по протоколу HTTP 1.1.

C помощью различных сервисов (таких как ) можно узнать, действительно ли это заходил робот поисковой системы, а не пользователь с какого-либо сервиса, например с . В нашем случае страницу действительно посещал робот Яндекса:

netname: YANDEX-216

descr: Yandex search engine

А теперь рассмотрим подробнее роботов поисковых систем.

Яндекс

Поисковая система Яндекс имеет разнообразных роботов, специализирующихся на различных задачах.

- Yandex/1.01.001 (compatible; Win16; I) — основной индексирующий робот Яндекса, собирающий информацию со страниц сайтов.

- Yandex/1.01.001 (compatible; Win16; P) — индексатор картинок, которые впоследствии будут доступны при поиске в картинках.

- Yandex/1.01.001 (compatible; Win16; H) — робот, определяющий зеркала сайтов

- Yandex/1.03.003 (compatible; Win16; D) — робот, обращающийся к странице при добавлении ее через форму и определяющий доступность страницы для индексации.

- Yandex/1.03.000 (compatible; Win16; M) — робот, обращающийся при открытии страницы по ссылке «Найденные слова»

- YaDirectBot/1.0 (compatible; Win16; I) — робот, индексирующий страницы сайтов, участвующих в

- Yandex/1.02.000 (compatible; Win16; F) — робот, индексирующий иконки сайтов (favicons), которые показываются при просмотре сайта в левом углу заголовка окна браузера.

Кроме роботов у Яндекса есть группа роботов, которые определяют, доступен ли в данный момент сайт или документ, на который стоит ссылка в соответствующем сервисе.

- Yandex/2.01.000 (compatible; Win16; Dyatel; C) — «простукивалка» Яндекс.Каталога. Если сайт недоступен в течение нескольких дней, он снимается с публикации. Как только сайт начинает отвечать, он автоматически появляется в Каталоге.

- Yandex/2.01.000 (compatible; Win16; Dyatel; Z) — «простукивалка» Яндекс.Закладок. Ссылки на недоступные сайты помечаются серым цветом.

- Yandex/2.01.000 (compatible; Win16; Dyatel; D) — «простукивалка» Яндекс.Директа. Она проверяет корректность ссылок из объявлений перед модерацией. Никаких автоматических действий не предпринимается.

- Yandex/2.01.000 (compatible; Win16; Dyatel; N) — «простукивалка» Яндекс.Новостей. Она формирует отчет для контент-менеджера, который оценивает масштаб проблем и, при необходимости, связывается с партнером.

Рамблер

Поисковая система Рамблер имеет только одного робота, который представляется как «StackRambler/2.0 (MSIE incompatible)». Ip-адрес робота может лежать в пределах интервала 81.19.64.0 – 81.19.66.255

Например:

81.19.66.8 – – [18/Jun/2006:11:19:59 0400] “GET /robots.txt HTTP/1.0” 200 55 “-” “StackRambler/2.0 (MSIE incompatible)”

Робот поисковой системы Google представляется как “Mozilla/5.0 (compatible; Googlebot/2.1; http://www.google.com/bot.html)” и может ходить с ip-адресов 66.249.64.0 – 66.249.72.225

Например:

66.249.72.113 – – [18/Jun/2006:13:13:55 0400] “GET /robots.txt HTTP/1.1” 200 55 “-” “Mozilla/5.0 (compatible; Googlebot/2.1; http://www.google.com/bot.html)”

5. Управление роботом поисковой системы

Управление роботом поисковой системы ограничено и заключается в основном в установлении запретом на индексацию некоторых страниц сайта. На само расписание робота, на частоту его посещения можно лишь оказывать косвенное влияние.

Частота посещения страниц роботом

Обычно робот посещает страницу сайта исходя из того, как часто изменяется содержание этой страницы. На часто обновляемые страницы робот может ходить каждый день и даже чаще. Например, если это страница новостного сайта. Когда же страница изменяется нечасто, то робот посещает ее один-два раза в неделю. Те страницы, содержимое которых не меняется, все равно посещаются роботом, однако очень редко, не более трех раз в месяц.

При этом за один заход робот запрашивает не более 20-30 страничек с сайта. Это связано с тем, что роботы поисковых систем стараются не загружать сервер своими запросами. На сайт с большим количеством страниц робот ходит часто и каждый раз берет только небольшую «порцию» страниц.

Раньше, для управления частотой посещения роботом страницы веб-мастера использовали тег METANAME=”Revizit–after“.

Например, запись

META NAME=”Revizit-after” CONTENT=”2 days”

означала, что робот должен посещать страницу раз в два дня.

Однако сейчас использование тега не оказывает никакого влияния на частоту посещения страницы роботом, робот сам определяет частоту обновления страницы и на основе этого строит свое расписание. (см. эксперимент).

Запрет индексации

Запрет для индексации в отношении определенных страниц можно реализовать двумя способами: с помощью robots.txt или тега < meta name=”ROBOTS”>.

Для запрета индексации с помощью robots.txt требуется в поле user-agent указать имя робота и после disallow прописать конкретные страницы, которые требуется закрыть от индексации (подробнее см. мастер-класс про правильное составление файла robots.txt). Например, для запрета индексации всего сайта поисковой системой Google:

User-agent: Googlebot

Disallow: /

В случае использования мета-тега инструкции по индексации записываются в поле content. Возможны следующие инструкции:

Значение по умолчанию: < meta name=”Robots” content=”INDEX, FOLLOW”>.

Например, чтобы запретить индексирование страницы роботу поисковой системы Google требуется написать следующее:

< meta name=”googlebot” content=”noindex, nofollow”>

6. Заключение

Робот – это один из основных элементов любой поисковой системы. Он выполняет очень важные функции, связанные с индексацией сайтов м/p>

Современные поисковые роботы и индексация

Как мы видим, поисковой робот, который работал по этим алгоритмам, выдавал по запросу технические тексты, которые были не интересны пользователю.

Но аналога поисковой системы Google не было, она не теряла своей популярности, и ее разработчики поступили очень грамотно, переделав алгоритм поиска под нужды пользователя. На данный момент все существовавшие тогда уловки для работы с текстом, стали недействительными.

На данный момент поисковый робот Google для сайтов намного меньше уделяет вниманию анализу текста. Все усилия поисковика направлены на отсеивание технического материала, который создавался под поисковых роботов.

Анализируется много пунктов, не все они известны на данный момент, так как поисковые системы предпочитают держать такую информацию в тайне. Это нужно, чтобы не возникало подобных кризисов.

Такое развитие повлекло за собой множество изменений в SEO бизнесе. Во время кризиса роботизированных текстов все усилия оптимизаторов были направлены на то, чтоб сделать текст максимально комфортным для робота.

На данный же момент, алгоритмы поиска таковы, что больше нет смысла рассчитывать текст на робота. Гораздо больше результатов приносит материал, который интересен пользователю.

Достаточно провести минимальную оптимизацию, вводя в текст ключевые слова и сделать текст уникальным. Этого достаточно для поисковой системы, эти способы нужны скорее не для того, чтоб обмануть робота, а с той целью, чтоб облегчить ему задачу индексирования.

Следует отметить, что поисковый робот Google для сайтов, и сейчас учитывает «вес страниц» при ранжировании. Это один из самых основных показателей, который зарекомендовал себя за годы службы, нет причин думать, что он станет неактуальным.

Многие показатели анализа текста перестали учитываться или же им стало уделяться минимум внимания. Еще один интересный момент в работе поисковика Google.

Как уже говорилось выше, учитывается показатель отказов, это немного нарушает права пользователя об информационной анонимности, но такой способ позволяет реально определить качество сайта и данной страницы в частности.

Вот пример нескольких моментов, которые могут привести к повышению показателя отказов:

Вывод

За время работы поисковых систем, оптимизаторы пытались приручить роботов. Однако, только начав приручать, он снова менялся и уже не хотел работать со старым материалом. Такие попытки были всегда, и наблюдать их можно будет, пока существует интернет.

Все из-за того, что понять робота можно, его анализ, запросы и требования к материалу гораздо проще, чем у человека. Их всегда будут пытаться разгадать. Однако всегда будут люди, которые будут создавать сайты для пользователей и в итоге они получат свое признание.

Хоть этот путь долг и тернист, а развитие ресурса таким путем очень долгое, но оно в любом случае будет долгосрочным, так как роботы поисковых систем всегда будут искать именно такой материал. Следует отметить, что такая конкуренция это хорошо.

Если бы поисковик сдал позиции, то мы бы не получали нужной информации через него. А если бы оптимизаторы сложили руки, то интернет перестал бы быть такой большой бизнес площадкой, и в нем бы не было многих материалов, так как на добровольной основе ресурсы развивались бы намного медленнее.

Структура алгоритма работы поискового робота

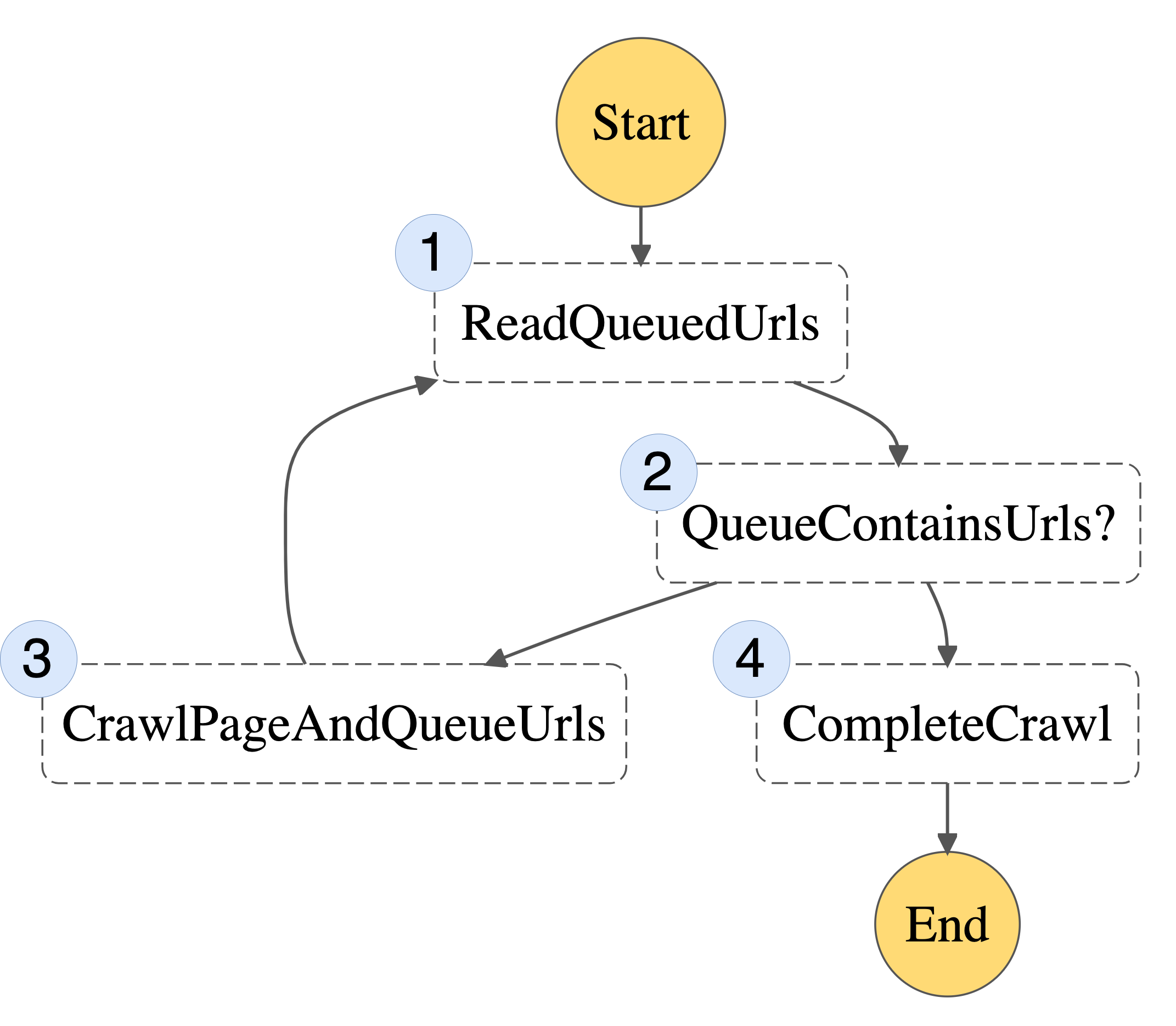

Система AWS Step Functions — это оркестратор бессерверных функций. Она позволяет выстроить последовательность из одной или нескольких функций AWS Lambda, чтобы получился более длительный по времени рабочий процесс. Данный алгоритм работы поискового робота можно разбить на этапы, за каждый из которых будет отвечать отдельная Lambda-функция.

Ниже показан вариант структуры конечного автомата для реализации подобного поискового алгоритма:

1. ReadQueuedUrls читает любые непосещенные URL-адреса из нашей очереди. 2. QueueContainsUrls? проверяет, остались ли необойденные URL-адреса. 3. CrawlPageAndQueueUrls берет URL-адрес из очереди, посещает его и записывает все вновь обнаруженные URL-адреса в очередь. 4. CompleteCrawl — когда в очереди не остается URL-адресов, работа завершается.

Каждая часть алгоритма может теперь быть реализована как отдельная Lambda-функция. Теперь уже весь процесс не регламентируется 15-минутным тайм-аутом — данное ограничение будет применяться к каждому отдельному шагу.

В тех случаях, где ранее, возможно, использовалась очередь в памяти, теперь потребуется очередь URL-адресов, которая будет сохраняться при переходе от одного шага к другому. Как вариант, можно передавать очередь на вход и выход в каждом шаге. Однако здесь вы можете столкнуться с ограничением на ввод-вывод для функций AWS Step Functions.

Чтобы этого избежать, можно представить очередь в виде таблицы Amazon DynamoDB, и тогда каждая Lambda-функция сможет писать в нее или читать из нее данные. Очередь требуется только на время обхода сайта. Это означает, что вы можете создать таблицу DynamoDB в самом начале выполнения и удалить ее после завершения работы поискового робота.

Устройство поисковых машин

Системы, использующие поисковых роботов;

Системы, управляемые человеком;

Гибридные системы;

Мета-системы.

В повседневном использовании Интернета пользователь часто сталкивается с системами на поисковых роботах таких компаний, как Google, Bing и Yandex. Данные продукты также называют поисковыми машинами.

Spider (паук или спайдер) – программа, скачивающая страницы из Интернета для последующего анализа и запоминания в базу данных.

Crawler (краулер, паук-путешественник) – программа, которая ищет полезные ссылки на странице ресурса и осуществляет переход по ним. Логика обхода страниц определяется алгоритмами информационного поиска.

Indexer (индексатор) – компонент, осуществляющий вычленение полезной информации со страницы и сохраняющий полученный результат в структурированном виде в базу данных поисковой машины.

Database (база данных) – огромный каталог обработанных системой страниц сайтов, использующийся для поиска информации на проиндексированных сайтах.

Search engine results (система выдачи результатов) – система, предназначенная для извлечения необходимых данных из каталога по запросу пользователя.

Web server (веб-сервер) – веб-сервер, связывающий конечного пользователя с поисковой системой.

Под поисковым роботом, пауком или агентом принято понимать комплекс, состоящий из паука, краулера и индексатора.

Поисковый агенты пишутся на языках высокого уровня. Это позволяет им эмулировать поведение обычных браузеров или решать специализированные задачи: использование сетевого протокола передачи новостей NNTP, получение электронной почты по SMTP или чтение лент новостей из RSS.

Робот-индексатор:

Страниц для web-браузера десктопа.

Страниц для web-браузера смартфона.

Робот по изображениям.

Робот по видео.

Робот по новостям.

Робот-индексатор занимается обнаружением и индексацией страницы. Под индексированием понимается процесс извлечения данных из веб-страницы, с последующим извлечением в специальную базу поисковика.

Робот-индексаторы бывают основными и быстрыми. Основной робот занимается индексированием нового контента, быстрый – обновляет индекс часто меняющихся страниц.