- Что такое искусственно интеллектуальные роботы?

- Автоматная модель

- Нейронная сеть

- 9. Домашние роботы

- Поощрение и наказание

- Некоторые замечания к условно-рефлекторному поведению

- 14. Военные роботы (Россия)

- 11. Беспилотные летательные аппараты (БПЛА)

- 12. Наземные боевые роботы

- 13. Морские роботы

- 15. Промышленные роботы

- 17. Роботы-охранники

- 30. Первые Международные Олимпийские Игры человекоподобных роботов

- 22. Роботы для медицины – протезы

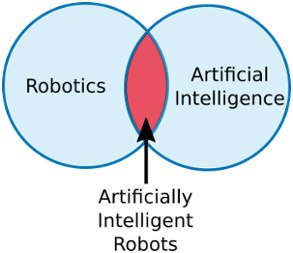

Что такое искусственно интеллектуальные роботы?

Искусственно интеллектуальные роботы — это мост между робототехникой и искусственным интеллектом. Это роботы, которые контролируются программами ИИ.

Многие роботы не используют ИИ. До недавнего времени все промышленные роботы были запрограммированы только для проведения повторяющихся серий движений. Как мы уже говорили, повторяющиеся движения не требуют искусственного интеллекта.

Неинтеллектуальные роботы довольно ограничены в своей функциональности. Алгоритмы ИИ часто необходимы, чтобы робот мог выполнять более сложные задачи.

Давайте посмотрим примеры.

Пример 1: Робот без ИИ

Например, вы можете легко запрограммировать робота, чтобы забрать объект и поместить его в другое место. Робот будет продолжать выбирать и размещать объекты одинаково, пока вы не отключите его. Это автономная функция, так как робот не требует человеческого вмешательства после того, как вы его запрограммировали. Однако задача не требует никакого интеллекта.

Пример 2: Искусственно интеллектуальный робот

Представьте, что вы хотели добавить камеру к вашему роботу. Взгляд робота подпадает под категорию «восприятия» и обычно требует алгоритмов ИИ.

Например, скажем, вы хотите, чтобы робот обнаружил объект, который он собирал, и поместил его в другое место в зависимости от типа объекта. Это предполагает подготовку специализированной программы видения для распознавания различных типов объектов.

Д.А. Добрынин

ВИНИТИ РАН

Робот – это машина с антропоморфным

(человекоподобным) поведением, которая

частично или полностью выполняет функции

человека (иногда животного) при

взаимодействии с окружающим миром

Программные. Жестко заданная программа (циклограмма).

Адаптивные. Возможность автоматически перепрограммироваться

(адаптироваться) в зависимости от обстановки. Изначально задаются

лишь основы программы действий.

Интеллектуальные. Задание вводится в общей форме, а сам робот

обладает возможностью принимать решения или планировать свои

действия в распознаваемой им неопределенной или сложной обстановке.

Исполнительные органы

Датчики

Система управления

Модель мира

Система распознавания

Система планирования

действий

Система выполнения действий

Система управления целями

Автоматная модель

Одной из наиболее эффективных и простых моделей

условно-рефлекторного поведения является вероятностный автомат [Цетлин, 1969].

Имеется устройство с N датчиками и M эффекторами

(исполнительными механизмами). Таким образом, входной алфавит составляет X=2N

сигналов, а выходной – Y=2M (при условии независимой отработки устройством

каждого управляющего воздействия). При этом, в отличие от [Цетлин, 1969], рассматривается

автомат с детерминированной матрицей переходов по всем 2N

сигналам.

y(t 1) = F(x(t), q(t), P(t)),

q(t 1) = Q(x(t),q(t)).

Рис. 2. Стохастическая матрица действий

pij(t 1,s(t)) = pij(t,s(t)) (-1)s(t 1)×

g× pij(t,s(t))× [1-pij(t,s(t))]

pik(t 1,s(t)) = pik(t,s(t))-(-1)s(t 1)×

g× pik(t,s(t))× pij(t,s(t))

для k¹ j. 0£ g£ 1

Здесь g– параметр, определяющий скорость обучения.

Таким образом, с течением времени в ходе «дрессировки» автомат должен сформировать

необходимые значения вероятностей действий.

Рис.3.

Структура управляющего автомата

Однако на практике вполне можно обойтись автоматом

«без памяти» – с одним состоянием. На самом деле память реализована матрицей

P, но речь идет о том, что автомат не различает понятия «предыдущие

моменты времени».

Нейронная сеть

Для решения таких задач, как стимул-реактивное обучение,

вполне оправданным является использование нейронных сетей, причем достаточно

простой структуры – линейных однослойных сетей. Не в последнюю очередь выбор

столь просто модели обусловлен ограничениями вычислительных ресурсов робота.

Мы не будем останавливаться подробно на этой модели.

9. Домашние роботы

Задачи домашних

Ориентация и перемещение в

ограниченном пространстве с

меняющейся обстановкой (предметы в

доме могут менять свое

местоположение), открывание и

закрывание дверей при перемещении

по дому.

Манипулирование объектами сложной и

иногда заранее неизвестной формы,

например посудой на кухне или вещами

в комнатах.

Активное взаимодействие с человеком

на естественном языке и принятие

команд в общей форме

Mahru и Ahra (Корея, KIST)

PR2 умеет втыкать вилку в розетку

Учёные из Калифорнийского университета в

Беркли (UC Berkeley) впервые обучили робота

взаимодействию с деформирующимися

объектами. Как ни странно, но только сейчас

удалось научить машину работать с мягкими и,

главное, легко и непредсказуемо меняющими

форму предметами.

Поощрение и наказание

Реализация схемы наказания/поощрения. При

дрессировке обычно используется как наказание, так и поощрение. Теоретически

при выработке условных рефлексов можно обойтись исключительно наказаниями (отсутствие

наказания может и должно рассматриваться как поощрение). Однако отсутствие сигнала

поощрения значительно увеличивает время обучения автомата.

а за что, собственно, наказали? Для разрешения этой проблемы

в проекте был использован т. н. синхронный метод подачи оценочного воздействия.

Суть его сводится к тому, что после совершения действия автомат выдает сигнал

готовности к приему оценки и ждет в течение некоторого времени. По окончании

времени ожидания автомат выдает сигнал неготовности к приему. С точки зрения

эффективности организации взаимодействия обучаемого с учителем, это – наиболее

простой вариант.

Для поощрения/наказания может использоваться как

пульт ручного управления (радиоканал на 4 команды: поощрение, наказание и эмуляция

фотодатчиков-глаз), так и управляющая ЭВМ, использующая специальную программу

полной эмуляции входных/выходных сигналов робота через интерфейс RS232. «Дрессировка»

с помощью ЭВМ, естественно, значительно эффективнее, т.к.

при «ручной дрессировке»,

несмотря на издаваемые роботом звуковые сигналы готовности, промахи совершаются

оператором достаточно часто. Это тем более актуально, что для обучения какому-либо

рефлексу (типичный пример – «при попадании света в правый глаз робот должен

издать звуковой сигнал») требуется порядка 10-12 тактов обучения.

Некоторые замечания к условно-рефлекторному поведению

Поощрение и наказание. Рассмотренная схема

обучения с подкреплением (модель «стимул-реакция») обладает рядом требований

к балансу между актами поощрения и наказания.

Максимальная скорость обучения достигается при поощрении.

Фактически, при имеющихся параметрах достаточно одного акта поощрения для окончания

обучения.

Но и без наказаний обойтись нельзя. Если только поощрять,

то систему нельзя будет переучить (из-за вырождения векторов). Либо надо вводить

функцию забывания (угасания рефлекса).

Рис.4. Реакция элементов вектора на

сигналы поощрения-наказания

Выше говорилось, что в принципе можно обойтись одними

наказаниями. Но тогда процесс обучения займет значительно большее время. Очевидно,

что максимальная эффективность обучения достигается при комбинировании сигналов

поощрения-наказания.

·

Б-обучение (± – обучение). Учитель ограничивается сигналами поощрения

и наказания;

·

В-обучение. Здесь происходит формирование вектора управляющих

воздействий.

Обучение нейронных сетей. Очевидно, что

лучшие результаты обучения НС получаются при использовании В-обучения, при котором

происходит сравнение выходного вектора НС с эталонным вектором E. Использование

же Б-обучения в НС приводит к ухудшению качества обучения. При этом режиме обучения

выходной вектор НС сопоставляется с нулевым вектором E, что эквивалентно использованию

в обучении исключительно сигнала наказания.

14. Военные роботы (Россия)

Планы DARPA по

К 2015 году одна треть

транспортных средств будет

беспилотной

За 6 лет с 2006 г. планируется

потратить $14.78 млрд

К 2025 году планируется переход

к полноценной

робототехнической армии

Имеется много разработок

БПЛА различных типов

Имеются единичные образцы

наземной техники

Нет концепции применения

БПЛА в армии

Нет массового производства

ТУ-300

Дозор-600

БЛА-05 «Типчак»

МРК-27 – БТ

11. Беспилотные летательные аппараты (БПЛА)

2000 г. – 50 единиц

2010 г. – 6800 единиц (136 раз)

В 2010 г. командование ВВС США

впервые в своей истории намерено

приобрести больше беспилотных

аппаратов, нежели пилотируемых

самолетов. К 2035 все вертолеты станут

беспилотными.

X47B UCAS

RQ-7 Shadow

RQ-4 Global Hawk

RQ-11 Raven

2010 г. – 4.4 млрд. $

2020 г. – 8.7 млрд. $

Доля США – 72% всего рынка

32 страны мира производят около 250 типов

беспилотных самолетов и вертолетов

A160T Hummingbird

12. Наземные боевые роботы

-разминирование

-разведка

-прокладка линий связи

-транспортировка военных грузов

-охрана территории

Робот-танк BlackKnight

Транспортный робот BigDog

(Boston Dinamics)

13. Морские роботы

Обнаружение и уничтожение подлодок

Патрулирование акватории

Борьба с морскими пиратами

Обнаружение и уничтожение мин

Картография морского дна

катер ВМС США Protector

К 2020 г. в мире будет выпущено 1142 аппарата на

общую сумму 2,3 млрд. долл., из которой 1,1

млрд. потратят военные. Произведено будет 394

крупных, 285 средних и 463 миниатюрных

подводных устройства. В случае оптимистичного

развития событий объем продаж достигнет 3,8

млрд. долл., а в “штучном” выражении — 1870

роботов.

Подводный робот

REMUS 100 (Hydroid)

создано 200 экз.

15. Промышленные роботы

К 2010 г. в мире разработано более 270

моделей промышленных роботов, выпущено

1 млн. роботов

В США внедрено 178 тысяч роботов

В 2005 году в Японии работало 370 тысяч

роботов – 40 процентов от общего

количества во всем мире. На каждую тысячу

заводских сотрудников-людей приходилось

32 робота

К 2025 году из-за старения населения

Японии 3,5 миллиона рабочих мест будет

приходиться на роботов

Современное высокоточное производство

невозможно без использования роботов

Россия в 90-е годы потеряла свой парк

промышленных роботов. Массовое

производство роботов отсутствует.

17. Роботы-охранники

Патрулирование улиц

Охрана помещений и зданий

Воздушное наблюдение (БПЛА)

SGR-1

(охрана корейской границы)

Робот-охранник Reborg-Q (Япония)

30. Первые Международные Олимпийские Игры человекоподобных роботов

Роботы-животные

Роботы-игрушки

Робот-собака AIBO (Sony)

2000-2007 г.

Робот-динозавр PLEO

Роботы-собаки

Первые Международные Олимпийские Игры

человекоподобных роботов

Первые Международные Олимпийские Игры

22. Роботы для медицины – протезы

Обслуживание больниц

Наблюдение за больными

Развозчик лекарств MRK-03

(Япония)

Робот-хирург Da Vinci

Разработчик – INTUITIVE SURGICAL INC (USA)

2006 год – 140 клиник

2010 год – 860 клиник

В России – 5 установок

Оператор работает в нестерильной зоне у

управляющей консоли. Инструментальные

манипуляторы активизируются только в том

случае, если голова оператора правильно

позиционируется роботом.

Используется 3D изображение операционного поля. Движения рук оператора

аккуратно переносятся в очень точные

движения операционных инструментов.

Семь степеней свободы движения

инструментов предоставляют оператору

невиданные до сих пор возможности.

Робот-пациент STAN (США)

Робот дышит и говорит. И многих

студентов регулярно шокирует

“смерть” манекена — настолько он

реалистичен.

Используется в 370 госпиталях и

медицинских школах.

Робот для стоматологов Hanako

(Япония)

Она может изображать боль,

закатывать глаза и даже пускать

слюни. Кроме того, Hanako может

общаться с врачом и говорить,

например, «Мне больно».

Бионический протез руки i-Limb (Touch Bionics)

удерживает до 90 килограммов нагрузки

Серийно производится с 2008 г., 1200 пациентов по всему

миру.

Протез управляется

миоэлектрическими токами в

конечности, а для человека это

выглядит почти как управление

настоящей рукой. Вместе с

“пульсирующим захватом” это

позволяет инвалиду

производить более точные

манипуляции, вплоть до

завязывания шнурков или

застёгивания пояса.